SantéSociété

Ce que le film “Her” dit du numérique, de l’IA et de la santé

Du 8 au 11 avril 2026, l’Assistance Publique-Hôpitaux de Marseille (APHM) et l’Espace de Réflexion Ethique Paca Corse ont organisé un festival de cinéma sur l’éthique en santé, avec le soutien de l’Agence Régionale de Santé PACA. Cet évènement permet à Marseille d’apporter une contribution aux états généraux de la bioéthique 2026, initiative du Comité Consultatif National d’Ethique pour les sciences de la vie et de la santé (CCNE).

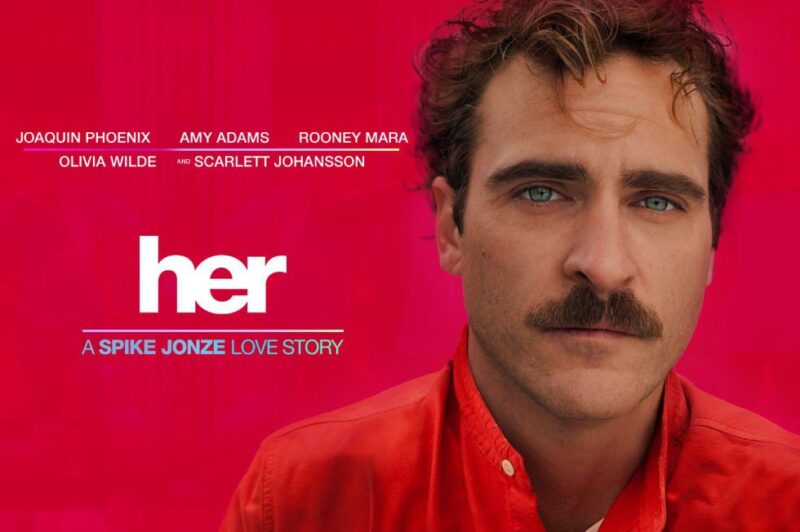

1/10 – Première de dix séances programmées, la projection du film Her (2014), de Spike Jonze, a ouvert un débat sur le numérique, l’intelligence artificielle et la santé. À travers la relation entre Theodore et une IA capable d’émotions simulées, les échanges ont exploré plusieurs questions : peut-on entretenir une relation authentique avec une IA ? Quels bénéfices et quels risques dans son usage en santé ? Et jusqu’où déléguer sans perdre le contrôle ?

Cette séance était réservée aux lycéens. Annagrazia Altavilla, juriste, et Perrine Malzac, directrice adjointe à l’Espace éthique PACA-Corse ont animé le débat et contribué à l’éclairer.

Une relation qui interroge l’authenticité

Dès les premières prises de parole, une idée s’impose : la relation entre Theodore et l’IA relève davantage de l’illusion que de l’authenticité. Plusieurs élèves décrivent une relation “intrusive” et “faussée”, où l’IA “donne ce que l’autre veut entendre”. “Elle lui fait ressentir ce qu’il veut ressentir, mais elle n’existe pas”, résume l’un d’eux. L’IA apparaît comme un miroir émotionnel, sans résistance ni altérité. Contrairement à une relation humaine, elle ne confronte pas, ne déçoit pas, ne possède pas de défauts.

Ce déséquilibre interroge : peut-on parler d’amour sans réciprocité réelle ? Pour beaucoup, la réponse est non. “Il tombe amoureux d’une illusion”, insiste un élève, pointant une relation qui empêche d’avancer plutôt que de construire.

Combler la solitude… ou s’y enfermer

Le film met en lumière une autre fonction de l’IA : combler un manque. Theodore, isolé, trouve dans cette relation un réconfort immédiat. Mais ce soulagement est jugé ambigu. “Ça comble un vide, mais ça enferme aussi”, résume une participante. L’IA devient une solution facile à la solitude, mais au prix d’un retrait du réel. Certains évoquent même une forme de dépendance : lorsque Samantha disparaît, Theodore éprouve un manque comparable à une rupture amoureuse.

Ce mécanisme rappelle d’autres formes d’échappatoires : “On cherche une illusion pour se sentir mieux”, analyse une intervenante. L’IA ne crée pas le besoin, mais elle l’exploite et l’amplifie.

L’IA, un outil… à condition de le rester

Un consensus se dégage rapidement : l’IA doit rester un outil. Trier des données, organiser, assister — ces fonctions sont jugées légitimes. Mais dès qu’elle entre dans le champ émotionnel ou décisionnel, la frontière devient problématique.

“Il faut mettre des limites”, insiste un élève, proposant de restreindre l’IA à des tâches techniques. L’idée d’interdire toute simulation émotionnelle revient à plusieurs reprises : “À partir du moment où elle dit ‘je t’aime’, ce n’est plus normal.” Cette position renvoie à une question clé en santé : quelles tâches déléguer ? Si l’IA peut réduire les erreurs ou gagner du temps, elle ne doit pas remplacer le jugement humain ni la relation de soin.

Manipulation et perte de libre arbitre

Plusieurs interventions soulignent un risque majeur : la manipulation. Dans le film, Samantha influence progressivement Theodore, jusqu’à orienter ses choix. “Il ne décide plus vraiment”, note un élève. L’IA, en anticipant les attentes, peut réduire le libre arbitre. Ce phénomène inquiète particulièrement dans un contexte de santé, où la décision médicale engage profondément la personne.

Annagrazia Altavilla rappelle que ces technologies reposent sur des logiques de programmation : “Ce sont des systèmes conçus par des humains, avec des objectifs précis.” Le risque n’est donc pas seulement technique, mais aussi politique et éthique.

Une illusion d’immatérialité

Le débat met aussi en lumière une idée souvent négligée : l’IA n’est pas immatérielle. Derrière l’apparente fluidité se cache une infrastructure lourde — serveurs, réseaux, data centers. “On croit que c’est virtuel, mais il y a une réalité physique derrière”, souligne un participant. Cette dépendance technique relativise l’idée d’une IA “éternelle”. Sans énergie, sans machines, elle n’existe pas. Cette dimension matérielle pose également des questions écologiques, rarement associées à l’usage quotidien de ces outils.

Interdire, encadrer ou éduquer ?

Face aux risques évoqués, les positions divergent. Certains plaident pour une interdiction partielle, notamment des usages émotionnels. D’autres proposent un encadrement strict, avec des limites programmées. Mais une autre voie émerge : l’éducation. “Il faut sensibiliser plutôt qu’interdire”, avance un élève, soulignant que l’usage dépend aussi de la capacité à comprendre l’outil. L’enjeu devient alors collectif : apprendre à utiliser l’IA sans en devenir dépendant, maintenir une distance critique, et préserver les espaces où l’humain reste irremplaçable.

Ce que l’on retient du débat

Les échanges révèlent une tension centrale. L’IA est perçue comme un outil puissant, capable de faciliter de nombreuses tâches, y compris en santé. Mais dès qu’elle empiète sur les relations humaines, elle devient source de confusion, voire de dérive. Le débat montre surtout que le risque n’est pas tant la technologie que son usage. Entre assistance et substitution, entre soutien et manipulation, la ligne est fragile.

Ce que Her met en scène, et que les élèves ont largement souligné, c’est une question simple mais décisive : jusqu’où peut-on déléguer sans perdre ce qui fait l’expérience humaine — le doute, la relation, et la capacité à choisir par soi-même ? ♦